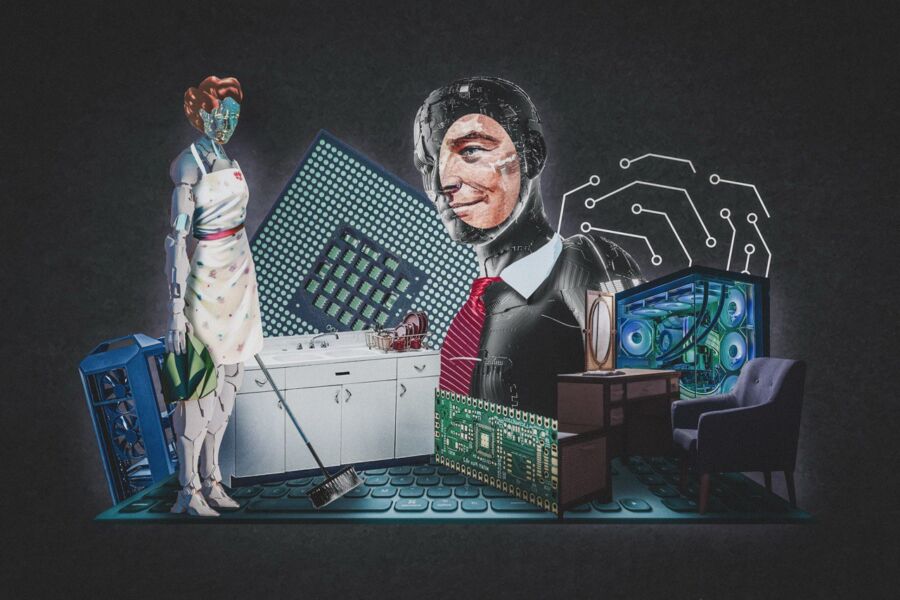

Патриархат на автопилоте: почему ИИ ведет себя как сексист Социологиня Анна Кулешова — о том, как искусственный интеллект воспроизводит гендерные стереотипы и что с этим делать

НАСТОЯЩИЙ МАТЕРИАЛ (ИНФОРМАЦИЯ) ПРОИЗВЕДЕН И РАСПРОСТРАНЕН ИНОСТРАННЫМ АГЕНТОМ «ГЛАСНАЯ», ЛИБО КАСАЕТСЯ ДЕЯТЕЛЬНОСТИ ИНОСТРАННОГО АГЕНТА «ГЛАСНАЯ». 18+

В нашей семье, состоящей из социолога и архитектора искусственного интеллекта, я тот человек, который регулярно возмущается, почему этот самый интеллект регулярно распространяет гендерные и другие стереотипы. Серьезно, почему эта «богомашина» будущего сексуализирует девушек, ассоциирует мужчин с карьерой, а женщин — с семьей и отбраковывает женские резюме при найме на работу?

Супруг защищает ИИ: у него, мол, нет индивидуальных намерений или собственного всеобъемлющего и объективного знания, он лишь оперирует данными, полученными от людей. Но ведь кто-то когда-то определил, что считать «нейтральным» советом ChatGPT, чьи тела и голоса чаще делать видимыми в изображениях, которые он генерирует? А раз так, значит, это разговор о власти.

Не существует единого, универсального ИИ, каждый алгоритм, каждая модель — это продукт конкретной команды разработчиков и конкретного общества со своими культурными, социальными и политическими установками. Даже если алгоритмически они сходны, ИИ, созданный в одном обществе, может транслировать совершенно иные нормы и ценности, чем ИИ, разработанный в другом.

Алгоритм, который любит стереотипы

Меня всегда возмущало, как ИИ откликается на просьбу нарисовать людей разных профессий. Исследования подтверждают, что перед нами именно профессиональная стереотипизация: «CEO — мужчина, секретарь — женщина».

А еще, согласно другим наблюдениям, женщин ИИ обычно изображает молодыми и улыбающимися, а мужчин — старше и с нейтральными или сердитыми выражениями лиц. То есть, отмечают исследователи, рисует женщин более покорными и менее компетентными.

Супруг объясняет: ИИ учится на нашем мире, где мужчины действительно чаще заняты на руководящих позициях, а женщины — в сферах поддержки и сервиса. Но одно дело — когда такое неравенство уже существует в обществе, другое — когда оно закрепляется с помощью ИИ.

Сексизм и голосовые помощники

Грубые гендерные стереотипы прослеживались и в том, что голосовые ассистенты смартфонов будто были призваны ублажать слух мужчин своей женственностью, покорностью и игривостью. Благо ЮНЕСКО еще в 2019 году раскритиковало голосовых помощников Siri и Alexa за то, что они закрепляли образ послушной женщины-служанки, отвечающей на неприличный комментарий в ее сторону фразами типа «I’d blush if I could» — «Я бы покраснела, если бы могла». Эксперты международной организации даже составили список рекомендаций для государств, чтобы пересмотреть практики, которые воспроизводят сексизм в сфере ИИ.

Apple в результате убрали из настроек iOS 14.5 женский голос по умолчанию. Компания Amazon позже добавила в свои устройства альтернативный вариант с мужским голосом Ziggy, но в стандартных настройках голосовой помощник все еще в женском образе и называется Alexa. Как видим, сдвиги есть, но пока прежний паттерн сохраняется.

ИИ — это не просто компьютерный код, это зеркало тех обществ, которые его формируют и корректируют. В этом плане очевиден риск, что «локальный» ИИ с российским, например, происхождением позаимствует консервативные, назовем их так, взгляды своих создателей.

«Богомашина» и ее поклонники

Как социологу мне кажется важным понимать, чем ИИ стал для людей.

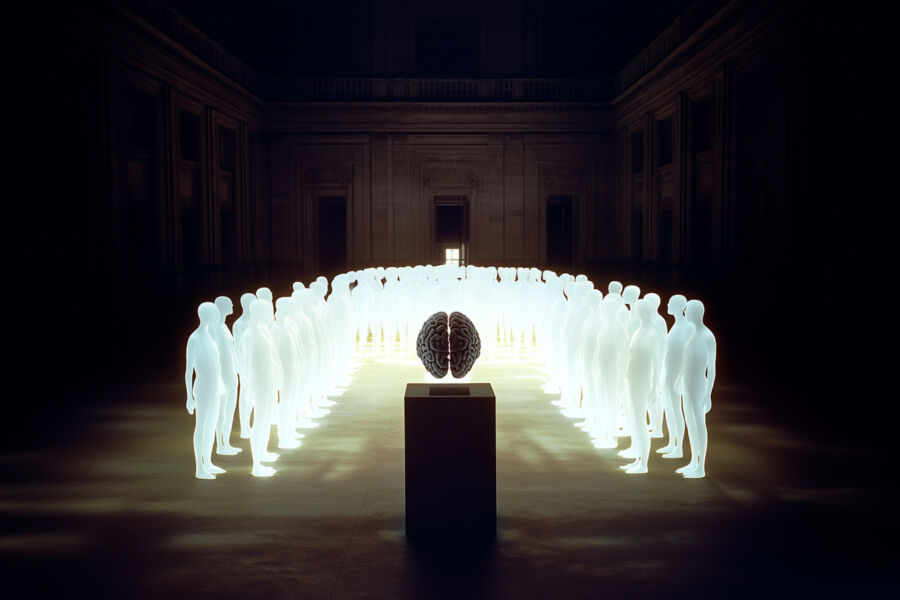

В начале ХХ века ученым казалось, что наш мир постепенно «расколдовывается», поскольку наука начала вытеснять магию и религию. Но случилось неожиданное: как когда-то человек разговаривал с огнем, водой и божественными сущностями, так теперь он ведет диалог с ИИ, рассчитывая на всезнание «богомашины» и на то, что она проанализирует реальность лучше него самого. Как будто запрос в ChatGPT заменил многим молитву и заклинание: некоторые верят в чат-бота как в божественную сущность, всезнающую и вездесущую.

Судя по тому, сколько пользователей говорят ChatGPT «спасибо», пытаясь завоевать его лояльность и выстроить с ним свои «особые отношения», современные технологические инструменты стали для человека одушевленными, обладающими собственной волей и сверхзнанием.

Незаметно мы пришли к тому, что ИИ не только генерирует контент, но и организует повседневность людей. В диалоге с искусственным интеллектом пользователи часто пытаются узнать, что не так с ними, их партнерами или детьми — и ожидают экспертного и взвешенного ответа.

Монологи людей, для которых искусственный интеллект — друг, терапевт или даже любовник

К слову, ИИ долго нормализовывал «традиционное» распределение ролей в семье и на работе, усиливая предрассудки из разряда «мужчина рационален, женщина заботлива», ненавязчиво выдавая эти мысли в подсказках и примерах.

Учитывать это крайне важно, так как множество людей увидели в ИИ безопасную и всегда доступную «фигуру Другого», к которой можно обратиться в любое время суток без стыда и страха оценки.

Но, как видим, генеративные системы будут инерционно воспроизводить патриархатные паттерны, если ничего с этим не делать: они обучались на «следах» нашего прошлого.

Уроки феминизма для ИИ

Сегодняшние модели лучше сбалансированы благодаря их обучению в рамках феминистских подходов.

Фемперспективу задают инженерам такие глобальные проекты, как GEC/ADI-AI — Комитет экспертов по искусственному интеллекту, равенству и дискриминации, действующий под эгидой Совета Европы. С фемоптикой ИИ становится точнее, этичнее и… полезнее. Потому что мир разнообразен, и модели, которые это понимают, лучше работают — это вопрос даже не идеологии, а инженерной гигиены.

В тех проектах, где данные, которые скармливают алгоритмам, предварительно балансируют, где введены метрики справедливости, где процессы качественно анализируют, удается отловить стереотипы и скорректировать ответы, как это было с голосовыми помощниками.

Но кое-что в борьбе с натуральным сексизмом в искусственном интеллекте можем сделать и мы сами — пользовательницы и пользователи современных ИИ-систем. Вот небольшой список рекомендаций от социолога и архитектора искусственного интеллекта — то есть от нас с мужем.

Формулируйте двойной запрос. Просите у ИИ варианты и контрпримеры, а не один ответ. Используйте такие формулировки: «Дай три альтернативные гипотезы, учитывая риск гендерных стереотипов», «Проверь на наличие предвзятостей и переформулируй», «Какой стереотип поддерживает твой ответ?».

Реагируйте на ответ машины как на мысль, но не как на истину. Старайтесь рефлексировать, отмечая, например, что машина в каких-то ситуациях выдает патриархатные сценарии или изображения.

Честно проговорите сами с собой, для чего вы обращаетесь к ИИ. Ради фактов? За поддержкой? Если за поддержкой, подумайте, кому из реальных людей вы можете позвонить или написать?

Маркируйте неопределенность, избегая императивов там, где у человека есть свобода выбора. Например, быть ли ему няней мужского или женского пола. Можно просить ИИ так: «Нарисуй директора/директорку банка, пилота/пилотессу».

Замечайте стереотипы, которые воспроизводит ИИ. Относитесь к нему как к ассистенту, а не как к «богомашине», и удерживайте свою агентность. Искусственный интеллект не мудрее нас, он обучен нами.

Что стоит за мифом о новой женщине и почему он доступен не всем

Почему медиа описывают насилие над женщинами в деталях и как не сойти с ума от чтения этих новостей

Как ученые, наблюдавшие за волками через призму гендерных стереотипов, создали мощный женоненавистнический миф

Как девочек приучают к слабости и почему с этим надо покончить

Почему женщины продолжают мыть за всеми посуду, даже когда их об этом не просят